Verifica le date inserite: la data di inizio deve precedere quella di fine

Rica Cerbarano

Leggi i suoi articoliLe immagini generate da Intelligenza Artificiale (IA) sono già qui, in mezzo a noi, da molto più tempo di quanto crediamo. «Il risultato potrebbe essere l’immagine di qualcosa che non è mai esistito, ma che l’algoritmo pensa vi piacerebbe vedere», scriveva Hito Steyerl nel 2014, in quel caso riferendosi alla creazione delle fotografie scattate con lo smartphone. Sono passati quasi dieci anni da questa affermazione, eppure quello che è successo nel 2022 ci ha preso completamente alla sprovvista, gettandoci in una confusione profonda e destabilizzante. I responsabili sono loro: DALL-E, Stable Diffusion, Midjourney. Nomi che richiamano un’atmosfera fantascientifica ed eterea, un orizzonte fatto di promesse e speranze per un futuro non troppo lontano, che sullo sfondo dello scontro abituale tra apocalittici e integrati vedrà lo sposalizio completo tra uomo e macchina.

Breve riassunto per i neofiti, o per chi si è perso per strada: ad aprile 2022 OpenAI lancia DALL-E 2, un programma per creare immagini a partire da un input di testo. Il processo è veloce (dai 25 ai 50 secondi) e non richiede nessuna competenza particolare, se non quella di essere in grado di formulare frasi di senso compiuto in inglese da dare in pasto all’algoritmo: questo, a partire da un database sterminato di immagini, individua i modelli che corrispondono alle parole chiave citate nel testo, li rielabora e genera un’immagine completamente inedita. All’inizio c’è una lista d’attesa per accedere al servizio, ma nel giro di un paio di mesi vengono ammesse un milione di persone.

Ad agosto «il miracolo»: Stable Diffusion, un programma simile a DALL-E 2, ma open source, viene reso disponibile a tutti; in contemporanea, viene lanciato Midjourney, un altro software che utilizza la tecnologia «text to image», eseguito sulla piattaforma Discord. È l’inizio della fine, qualcuno potrebbe dire. Internet diventa una Wunderkammer di immagini surreali e imperfette e proprio per questo affascinanti. Si diffondono per la rete scenari stranianti, fatti di ambientazioni futuristiche e umani dalle fattezze aliene.

Dopo solo un mese DALL-E 2 apre le porte a tutti e introduce una serie di nuovi strumenti, tra cui l’«outpainting», ovvero la possibilità di espandere un’immagine oltre i suoi confini originali. Il concetto di inquadratura viene superato. In poco tempo gli sviluppatori di programmi di postproduzione fotografica (come Photoshop o GIMP) iniziano a utilizzare Stable Diffusion per ampliare le possibilità creative dei propri utenti e a ottobre Shutterstock, colosso delle banche immagini, sigla un accordo con OpenAI per offrire ai propri clienti la possibilità di generare immagini ex novo.

Ma non è tutto oro quel che luccica. Gli artisti sono preoccupati, lamentano il rischio di vedere le proprie opere copiate, manipolate e stravolte dall’IA senza il loro consenso. Negli stessi mesi, Getty Images, tra le più importanti agenzie fotografiche, cita in giudizio OpenAI proprio per questioni relative al copyright delle cosiddette «immagini sintetiche» le quali, nel frattempo, grazie all’allenamento continuo dell’algoritmo, sono diventate sempre più fotorealistiche e persuasive.

Oggi, tra curiosità e indignazione (che fine farà la figura del fotografo, dell’illustratore, del «creatore di immagini»?), non è chiaro se tra gli addetti ai lavori ci sia un clima di tensione o fermento creativo. I curiosi si avvicinano agli strumenti generativi cercando di carpirne le possibilità, i più scettici rimangono a osservare.

Tra gli artisti che si sono affacciati alle potenzialità espressive di questo nuovo medium (sarà giusto chiamarlo così?) c’è Charlie Engman, fotografo americano che ultimamente su Instagram posta i risultati delle sue sperimentazioni. Quando, attratta dalle sue creazioni, gli chiedo che cosa lo spinga a esplorare questo campo, mi spiega: «Lavorando con le immagini generate da IA mi pongo una domanda che è sempre stata molto importante per me: in che modo le mie fotografie si relazionano con le immagini che le precedono e le circondano? Il processo di creazione e condivisione di queste immagini sta colmando il divario tra le varie discipline in un modo molto provocatorio, che aggiunge complessità alle conversazioni su alcuni temi importanti del fare arte, come la gerarchia, il consenso, l’accessibilità e il mito del genio individuale».

Chiedo il parere anche di Andrea Baioni, fotografo italiano che un anno fa ha cominciato a sperimentare con Midjourney, Stable Diffusion e altri programmi. In particolare mi interessa sapere quanto ci sia di fotografico, secondo lui, nelle immagini generate da IA. «Credo che la tecnologia sia ancora troppo acerba per creare immagini realmente fotografiche, risponde, ma spero che in futuro si possa arrivare a poter scegliere quale grado di fotorealismo e di illustrazione avere, anche mischiando i due linguaggi».

E per quanto riguarda la questione del copyright? «Come per chiunque la mia creatività nasce, oltre che da una mia visione del mondo e da un temperamento innato, anche e soprattutto dall’insieme di immagini, opere, testi, grafiche che ho visto e che consciamente o inconsciamente ricordo. Un dataset di esperienze personali. Così come non trovo immorale che la rielaborazione interiore di diverse opere altrui abbia creato le mie immagini, non trovo necessariamente sbagliato farlo tramite IA. Ma capisco chi la pensa nel senso opposto, e in parte nutro gli stessi dubbi».

La questione è, ovviamente, delicata, e non solo per l’arte. Che cosa comporterà tutto ciò su aspetti già problematici come la veridicità dell’immagine, il rafforzamento di stereotipi razziali e bias cognitivi, la manipolazione del pensiero e dell’opinione pubblica?

Lev Manovich, uno dei massimi esperti in materia, ha definito la diffusione di questi software generativi un cambiamento epocale, pari solamente all’invenzione della fotografia che nel 1839 sconvolse il mondo (e per cui molti, ricordiamocelo, gridarono allo scandalo). È davvero così? Staremo a vedere.

L’unica certezza è che il futuro dell’IA, come quello di ogni tecnologia, sarà determinato prima di tutto dall’utilizzo che ne farà l’uomo. Ancora una volta, che ci piaccia o no, è tutto nelle nostre mani.

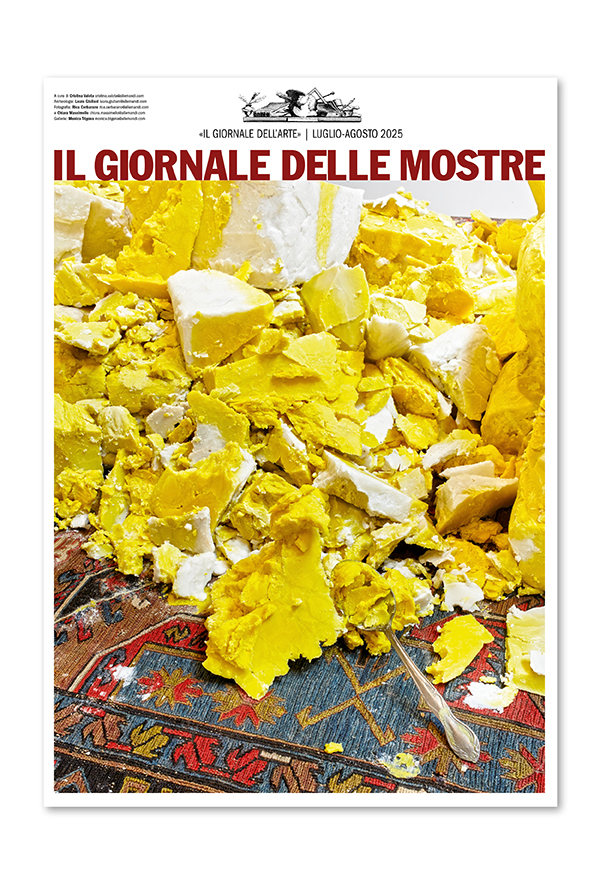

«Valentino Scuba» di Andrea Baioni, immagine generata con IA

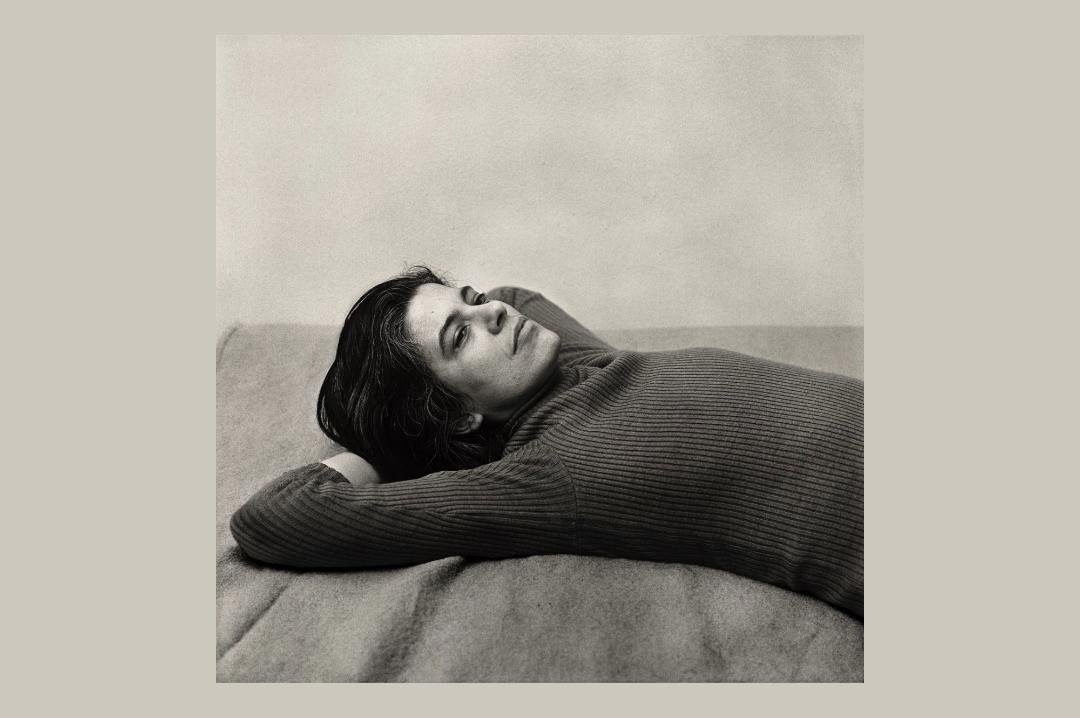

Un’immagine generata con IA, di Charlie Engman © Cortesia dell’artista

Altri articoli dell'autore

Il direttore de Les Rencontres d’Arles, la rassegna dedicata all’ottava arte più longeva e prestigiosa del mondo, ci racconta il suo festival: artisti emergenti, grandi maestri e un legame forte con il territorio

Alla Bundeskunsthalle di Bonn una mostra ricca di immagini e spunti sulla vita di una delle voci più lucide del contemporaneo. Resta però in superficie l’analisi della sua riflessione sull’etica della fotografia

In occasione di una mostra in Svizzera, l’artista sudafricano racconta come spinge la fotografia oltre i suoi limiti «per rivelare qualcosa che risiede sotto la superficie del mondo visibile»

In occasione della mostra alla Fondazione Mast, abbiamo incontrato l’artista franco-algerino per parlare di comunità, esperienza e relazioni