Verifica le date inserite: la data di inizio deve precedere quella di fine

Laura Castelli

Leggi i suoi articoliIn queste ultime settimane la High Court of Justice di Londra e il Tribunale Regionale di Monaco di Baviera si sono pronunciati sull’uso di opere protette nell’addestramento dell’IA giungendo a esiti differenti, basati su una diversa interpretazione giuridica del modo in cui l’Intelligenza Artificiale tratta contenuti protetti dal diritto d’autore. A Londra Getty Images aveva citato in giudizio Stability AI per aver usato senza permesso milioni di immagini coperte da copyright, prelevate da Getty, per addestrare il suo modello di IA.

Nel corso della causa Getty Images aveva peraltro ritirato l’accusa relativa al training della macchina, non essendo riuscita a reperire prove del fatto che le violazioni del diritto d’autore fossero avvenute all’interno del Regno Unito, mantenendo la sola accusa di secondary infringement (forma di responsabilità che colpisce non chi crea la copia illecita, ma chi supporta o facilita tale copia) per aver importato nel Regno Unito il modello addestrato all’estero.

L’accusa è stata respinta dalla Corte per il fatto che il modello di IA incriminato non conteneva copie delle immagini originali, né aveva memorizzato o riprodotto file contenenti opere di Getty: ai giudici, dunque, non è parsa sufficiente la denuncia dell’uso di immagini coperte dal diritto d’autore, richiedendo la dimostrazione del fatto che esse esistessero in copia all’interno del modello o che fossero state replicate.

A esiti opposti è pervenuto il Tribunale tedesco, il quale ha stabilito che OpenAI ha violato il diritto d’autore utilizzando testi di canzoni gestiti da GEMA-società di gestione di diritti d’autore per addestrare i propri modelli di IA.

Secondo i giudici questi ultimi non si sarebbero limitati ad apprendere lo stile dei brani, ma avrebbero memorizzato parti sostanziali dei testi originali, rendendole riproducibili su richiesta degli utenti. Su queste basi è stata riconosciuta una violazione dei diritti di riproduzione ed è stato inibito a OpenAI di utilizzare testi protetti dal diritto d’autore senza licenza. Tale pronuncia costituisce un precedente storico in Europa e potrebbe avere ripercussioni significative sull’intero settore dell’Intelligenza Artificiale, muovendo le aziende a rivedere le pratiche di raccolta dei dati e a cercare licenze esplicite per l’uso di contenuti protetti.

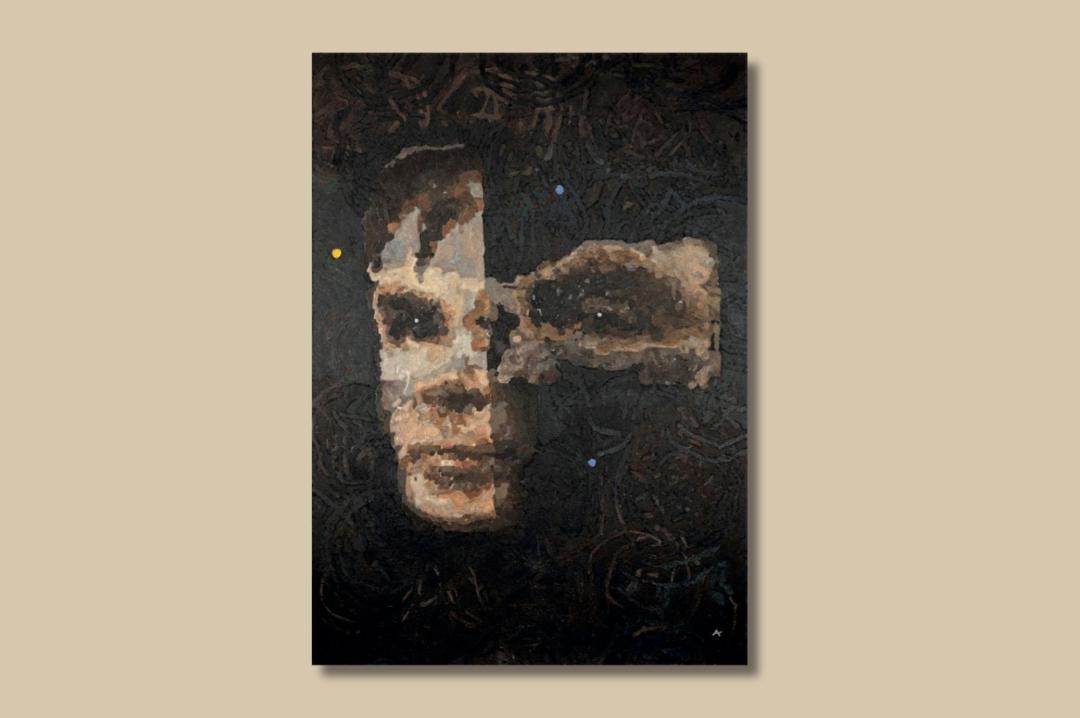

È ormai noto, infatti, come le IA generative necessitino di enormi quantità di dati per apprendere schemi visivi e produrre nuove immagini: ciò ha suscitato un dibattito, a livello internazionale, sul difficile bilanciamento tra innovazione tecnologica e tutela del diritto d’autore. Risale alla primavera scorsa la petizione, sottoscritta da più di 6mila artisti, con cui si è chiesto a Christie’s di sospendere l’asta «Augmented Intelligence», la prima dedicata solamente a opere generate tramite IA e Machine Learning.

La casa d’aste non ha dato seguito a tale richiesta, manifestando al contrario entusiasmo per l’iniziativa e, più in generale, per i nuovi sistemi di IA generativa e la vendita si è conclusa con un ricavo totale di circa 730mila dollari.

In attesa di conoscere quali linee guida in materia di diritto d’autore verranno emanate oltreoceano dallo U.S. Copyright Office, con la pubblicazione della terza parte del rapporto sulle questioni legali e politiche relative al diritto d’autore e all’IA, è lecito domandarsi se e quali regole del nostro Paese siano in grado di fornire una risposta ai quesiti che le pratiche appena descritte pongono. Il contesto normativo è complesso, vedendo l’intersezione tra il diritto d’autore tradizionale e le più recenti regolamentazioni sull’uso dei dati. La direttiva (UE) 2019/790 sul diritto d’autore nel mercato unico digitale, recepita nel nostro ordinamento con il decreto legislativo 177/2021, ha in particolare introdotto specifiche regole per il cosiddetto text and data mining (TDM) definito, all’art. 2, come «qualsiasi tecnica di analisi automatizzata volta ad analizzare testi e dati in formato digitale avente lo scopo di generare informazioni, inclusi, a titolo non esaustivo, modelli, tendenze e correlazioni». L’art. 3 prevede poi un’eccezione al potere escludente del diritto d’autore in favore degli istituti di ricerca e agli enti di patrimonio culturale, rispetto alle attività di estrazione di testo e di dati utili per scopi di ricerca scientifica. Laddove ad accedere a queste informazioni siano privati e aziende, tale necessità è regolata dall’art. 4, che prevede un’eccezione più ampia, consentendo il text and data mining per qualsiasi finalità, prevedendo al contempo ai titolari dei diritti d’autore di esercitare il cosiddetto opt-out, vietando che i propri testi e i dati delle proprie opere possano essere utilizzati per l’addestramento di modelli di intelligenza artificiale.

La disposizione in esame pone una serie di problemi applicativi, dipendenti dal fatto che le modalità operative di esercizio dell’opt-out appaiono oggi tutt’altro che semplici: il titolare di opere protette dal diritto d’autore potrà senz’altro manifestare il proprio rifiuto attraverso misure tecnologiche di protezione; ove però si dovesse trattare di opere pubblicamente disponibili online, la legge impone l’utilizzo di «strumenti che consentano lettura automatizzata», senza specificare come debba essere espresso tale rifiuto. Occorre considerare che attualmente non esistono standard univoci adottati da tutti i sistemi e ciò rende complesso l’esercizio del diritto di opt-out, essendo elevato il rischio che esso non sia leggibile dalla macchina, tutte le volte in cui sia espresso in un formato che i sistemi informativi non sono in grado di riconoscere automaticamente senza necessità di interpretazione manuale.

Nel recepire la direttiva 2019/790 summenzionata, il nostro Paese non ha disciplinato la fase di input, ovvero quella in cui l’Intelligenza Artificiale riceve e acquisisce dati.

Il Parlamento europeo, dal canto suo, nonostante abbia integrato il testo dell’AI Act (il Regolamento U.E. 2024/1689 che stabilisce regole armonizzate sull’Intelligenza Artificiale) poco prima della sua emanazione, proprio al fine di far fronte ai problemi che l’utilizzo di opere autoriali senza il consenso dei titolari potrebbe generare, ha dedicato alla fase di input soltanto la previsione di cui all’art. 53, par. 1, lett. d), ove si sancisce l’obbligo per i fornitori di IA di redigere e mettere a disposizione del pubblico «una sintesi sufficientemente dettagliata dei contenuti utilizzati per l’addestramento del modello di IA». Tale norma, invero, non impone particolari obblighi in fase di analisi, se non quello di rendere trasparente l’utilizzo del materiale impiegato per l’addestramento della macchina. Peraltro, anche laddove il legislatore scegliesse in futuro di regolare tramite restrizioni l’utilizzo di immagini in fase di analisi, tale limitazione si troverebbe necessariamente a fare i conti con il fatto che, tra gli obblighi che si potrebbero imporre, molti sarebbero difficili da rispettare, con il rischio di overregulation: si pensi alla possibilità che i fornitori di servizi di IA decidano di addestrare i propri algoritmi con banche dati disponibili in Paesi che possiedono regole di tutto vantaggio per le attività di machine learning. Inoltre, un autore potrebbe avere difficoltà a dimostrare che una sua opera è stata utilizzata ai soli fini di addestramento della macchina. Di contro, sarebbe evidente l’uso di un’immagine protetta dal diritto d’autore laddove la macchina ne creasse una copia; o anche se elaborasse un’opera identica a una già esistente e tutelata, attribuendosene la paternità; o, ancora, se ne creasse una che fosse il frutto di elaborazione e trasformazione di altra protetta.

Nel primo caso, l’opera copiata sarebbe tutelata dalle norme autoriali, salvo che le copie realizzate non siano riconducibili a una delle eccezioni riconosciute dalla direttiva, come è accaduto nella prima controversia instaurata in materia in Europa, che ha visto coinvolti il fotografo Robert Kneschke e LAION (Large-scale Artificial Intelligence Open Network): l’artista ha contestato a quest’ultima il fatto di aver costruito un dataset contenente un link per ogni immagine oggetto di possibile estrazione e copia, tra cui compariva anche una sua opera coperta dal diritto d’autore.

La Corte distrettuale di Amburgo ha in questo caso ritenuto applicabile l’eccezione connessa alle finalità di ricerca scientifica, che ha interpretato in senso lato, includendo anche il lavoro necessario all’acquisizione di conoscenza futura, come ad esempio la raccolta di enormi quantità di dati utili a giungere a conclusioni empiriche attraverso un metodo induttivo.

Laddove invece la macchina producesse un’opera identica a un’altra protetta dal diritto d’autore, attribuendosene la paternità, ci si troverebbe di fronte a un plagio: nonostante non ci sia nella legge italiana alcun esplicito riferimento a tale condotta, si è soliti ricondurre questo illecito, denominandolo «plagio-contraffazione», alla previsione di cui all’art. 156 della Legge sulla protezione del diritto d’autore, che disciplina l’ipotesi in cui venga violato un diritto di utilizzazione economica, cui peraltro normalmente si accompagna la falsa attribuzione della paternità in capo a un soggetto diverso dall’autore

Qualora invece l’IA rielaborasse l’opera utilizzata, creandone una nuova, per valutare la liceità di quest’ultima occorrerà usare i criteri validi per i casi in cui ad appropriarsi di un’opera sia un artista in carne e ossa: ai fini della liceità dell’opera, occorrerà verificare che essa rientri nei parametri della cosiddetta appropriation art, quella forma d’arte caratterizzata dal fatto di utilizzare deliberatamente creazioni altrui allo scopo di trasmettere un messaggio ulteriore e diverso da quello evocato dall’opera originaria; ciò implicherebbe a sua volta che l’opera prodotta dalla macchina abbia un fine concettuale e sia portatrice di un messaggio critico: questo è sicuramente allo stato ipotizzabile nel caso di creatività assistita, in cui vi è un ruolo attivo dell’umano nel guidare l’algoritmo, ma non si può escludere che un’opera appropriazionista possa in futuro essere il frutto anche di una creatività automatizzata, laddove l’IA riuscisse a sviluppare abilità tali da trasformare opere immesse nella macchina, proprio al fine di attribuire a queste ultime un significato diverso e nuovo da trasmettere alla società.

Altri articoli dell'autore

Rimedi a disposizione dell’acquirente di un’opera d’arte falsa e relativi termini di prescrizione

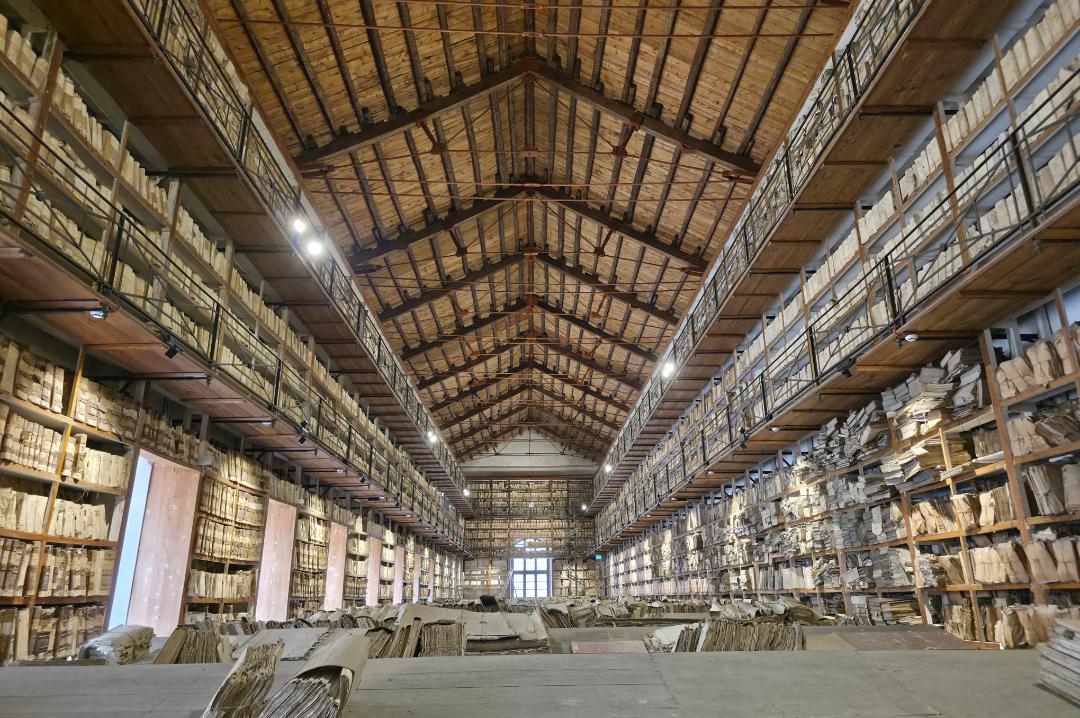

Per curarlo al meglio, secondo il giurista Antonio Leo Tarasco, direttore generale Archivi del Ministero della Cultura, è necessario creare ruoli tecnici dedicati al diritto e alla gestione dei beni culturali

Nel proprio saggio, Barbara Mastropietro analizza i profili civilistici del transito nazionale e internazionale delle opere d’arte